Los chats temporales actuales con ChatGPT de OpenAI no son tan privados como podrían ser, pero eso podría estar a punto de cambiar.

En un chat público reciente, el director ejecutivo de Open AI, Sam Altman, anunció planes para añadir una capa de cifrado a los chats temporales que podría ofrecer aún más privacidad a los usuarios.

Eso es una victoria para la privacidad, pero podría resultar problemático si las fuerzas del orden necesitan acceder a cualquier dato útil. Actualmente, ChatGPT almacena incluso las conversaciones temporales durante 30 días antes de eliminarlas.

Si a eso le sumamos el hecho de que la empresa está obligada legalmente, al menos a nivel local, a entregar los registros de chat cuando se le solicite, eso deja un vacío bastante considerable en la privacidad.

El plan para llenar ese vacío de privacidad es añadir una capa de cifrado a los chats temporales, afirma Altman. Eso significa que, si OpenAI se viera obligada por ley a entregar los registros de chat de su base de datos ChatGPT, todos ellos estarían cifrados y, en teoría, serían ilegibles.

Aunque los chats actuales pueden ser bastante personales y privados, ya que incluyen detalles médicos, cuestiones legales, información relacionada con el trabajo y mucho más, no son tan seguros como la gente podría pensar.

El uso del modo de chat temporal, en el que la IA no recuerda la información ni la utiliza para el aprendizaje automático, puede parecer privado, un poco como usar una pestaña de incógnito en un navegador. Pero la verdad es que, en realidad, es mucho más expuesto.

En el podcast en el que habló sobre este tema, el director ejecutivo añadió: "Así que, si vas a hablar con ChatGPT sobre tus asuntos más delicados y luego hay una demanda o algo así, podrían exigirnos que lo reveláramos. Y creo que eso es un desastre".

Hablando sobre el uso de ChatGPT para conversaciones privadas, Altman señaló anteriormente la dificultad a la que se enfrenta OpenAI: "En este momento, si hablas con un terapeuta, un abogado o un médico sobre esos problemas, existe el privilegio legal. Existe la confidencialidad entre médico y paciente, existe la confidencialidad legal, lo que sea. Y aún no hemos resuelto eso para cuando hablas con ChatGPT".

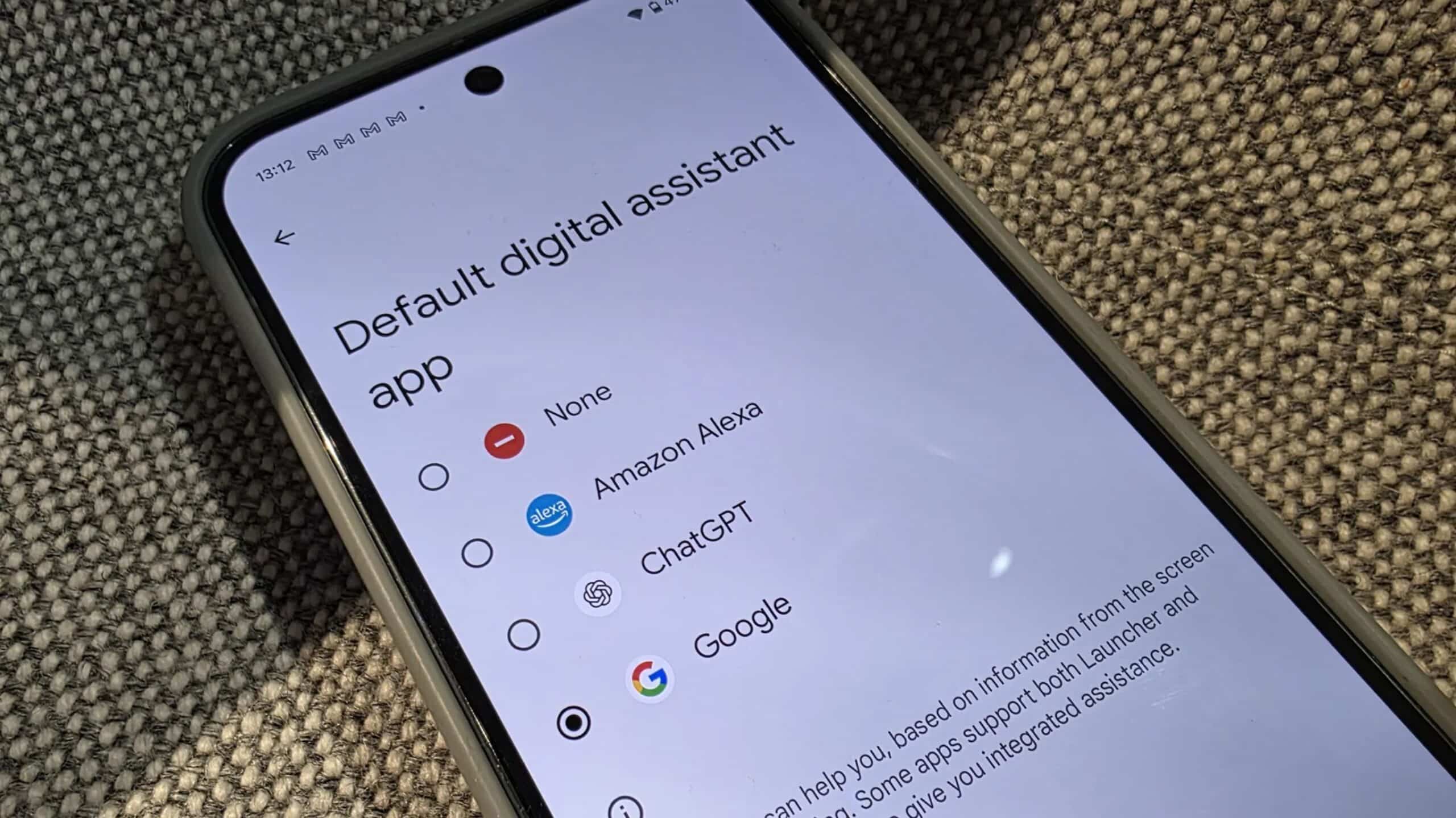

Esta es una de las razones por las que varias empresas han protegido sus propios chatbots de IA. Lumo, por ejemplo, utiliza las funciones de privacidad y cifrado de Proton para garantizar la protección de tu privacidad.

Hablando sobre este tema, Axios informa que Altman dijo a los periodistas: "Nos lo tomamos muy en serio".

Cabe señalar que el hecho de que los chats se almacenen durante 30 días parece formar parte de la política de OpenAI. ¿El motivo? Simplemente se cita como parte de los requisitos de "seguridad" de la empresa.

Bloquear los chats temporales tras una capa de cifrado puede que no cambie esa política de 30 días, pero debería significar que se mantiene la privacidad, al menos, en ese estado bloqueado.

Los datos de chat cifrados significarán que solo la persona que tenga la clave para descifrarlos podrá acceder a ellos. Quién tiene esa clave y qué podría obligarle a desbloquearla y compartirla no está tan claro en esta fase inicial.

También cabe señalar que, por el momento, no se ha revelado ningún calendario ni planes concretos.